Questo lungo post prende le mosse dai render del progetto “Rotterdam ROCKS!” dello studio olandese MVRDV per sviluppare una riflessione critica sul ruolo della rappresentazione nei processi di progettazione architettonica contemporanea. A partire da questo caso sintomatico, il testo ripercorre la co-evoluzione tra immagine e progetto attraverso alcune tappe fondamentali: la stagione del decostruttivismo e l’emergere del diagramma come dispositivo esplorativo; il contributo teorico di fotografia e cinema alla costruzione dell’autonomia dell’immagine rispetto al proprio referente; la transizione dall’analogico al digitale e la conseguente decostruzione dell’aporia mimetica. Attraverso una tassonomia delle immagini mediate — poietiche, virtuali e mediatiche — il testo descrive come il render digitale abbia progressivamente spostato il proprio statuto da strumento descrittivo a simulacro costruttivo, capace di rendere credibile anche ciò che eccede i canoni della costruzione. Nell’ultima parte, il saggio affronta le implicazioni dell’intelligenza artificiale generativa nei flussi di lavoro progettuali, introducendo il concetto di folie à deux per descrivere la co-dipendenza circolare tra progettista e GenAI, e il rischio di una conformità visuale che erode la ricerca della differenza. Il testo si conclude con un invito a considerare il render come postura critica e atto di resistenza culturale, nella consapevolezza che la questione dell’autorialità progettuale si ripropone oggi con urgenza rinnovata (immagine di copertina di Shubham Dhage su Unsplash).

Da Alles ist Architektur (tutto è architettura) ad Alles ist Bild (tutto è immagine): il render come garanzia progettuale

Recentemente mi è capitato di vedere i render del progetto “Rotterdam ROCKS!” di MVRDV. Si tratta di immagini con ambientazioni e punti di vista tipici dell’archviz (architectural visualization), che rappresentano tuttavia un edificio estremamente atipico. Lo studio olandese è tra i cinque finalisti del recentissimo concorso internazionale “Shift Landmark” (2025), promosso da Shift, una società dedicata all’imprenditoria sociale attraverso progetti urbani. Il progetto Landmark include in tutto 6 edifici/quartiere, uno per continente. Il primo, per Rotterdam, prevede di realizzare una costruzione di circa 30.000 mq, a fronte di un investimento di circa 240 milioni di euro. Il sito web Designboom riporta che il progetto “Rotterdam ROCKS!” è come ‘un paesaggio di volumi porosi descritti come rocce viventi’ (a questo link trovate anche i render). A vedere i render pubblicati on line, se ne ricava una strana sensazione, come se non fosse più così scontato che il rapporto tra immagine e progetto debba necessariamente essere descrittivo. Il risultato sembra sublimare la coerenza progettuale dietro una metafora formale (quella di sassi giganti accatastati), costruttivamente fragile ma in grado di alimentare il nostro immaginario. Nonostante questa risicata coerenza interna tra concept e costruzione, i render di “Rotterdam ROCKS!” riescono ancora a trattenere il progetto dalla sua deflagrazione finale, lo puntellano nella sua quasi dichiarata autodistruzione. L’immagine digitale funge come da garanzia che, in fondo, esista davvero, anche per questo anti-edificio, un progetto costruibile.

Per similitudine concettuale, vengono in mente i collage di Hans Hollein e il suo Alles Ist Architektur del 1968. In quel testo l’architetto austriaco affermava che:

‘Gli architetti devono smettere di pensare esclusivamente in termini di edifici. L’architettura costruita e fisica, liberata dai limiti tecnologici del passato, opererà in modo più intenso sia sulle qualità spaziali che su quelle psicologiche. Il processo di costruzione assumerà un nuovo significato, gli spazi avranno in modo più consapevole proprietà tattili, ottiche e acustiche. Una vera architettura del nostro tempo dovrà ridefinirsi ed espandere i propri mezzi. Molti ambiti al di fuori dell’edilizia tradizionale entreranno nel regno dell’architettura, così come l’architettura e gli “architetti” dovranno avventurarsi in nuovi campi. Tutti sono architetti. Tutto è architettura’. (Hans Hollein 1968)

la costruzione rimane ancora un’importante verifica della bontà di un progetto, ma non è più la principale

La prospettiva indicata da Hollein sembra più che mai attuale. Si ha la sensazione che oggi stiano cambiando sia i progettisti che gli edifici, grazie ad una creatività diffusa – e sempre meno normata – alimentata dalle immagini digitali. Nei render di architettura la costruzione rimane ancora un’importante verifica della bontà di un progetto, ma non è più la principale. In questo contesto, nel quale tutto sembra essere traducibile in immagini – Alles Ist Bild (tutto è immagine), per parafrasare Hollein – diventa importante capire quanto, della complessità dei processi progettuali, stiamo affidando ad esse. Non intendo affermare che ci troviamo necessariamente di fronte ad un appiattimento della ricerca progettuale. Per chi ha uno sguardo ben allenato, alcune immagini sono ancora dei progetti, mentre altre immagini non lo sono per nulla. E’ ciò che avviene all’interno delle procedure di rappresentazione digitale – tutte con diversi gradi di automazione – a costituire il focus di quanto segue, poiché la rappresentazione è parte integrante dei processi di design e del loro authoring.

I primi indizi per la nostra indagine possono essere individuati sintomaticamente nei render di “Rotterdam ROCKS!”. Nel momento in cui l’immagine diventa la modalità prevalente di rappresentazione del progetto d’architettura, torna utile far procedere la nostra indagine dal sintomo fino alla sua causa, cioè al modo in cui lo studio MVRDV ha costruito, nel tempo, le proprie procedure di progettazione e di rappresentazione. Lo studio olandese è stato uno tra i primi studi della sua generazione a lavorare principalmente paper free grazie al digitale. Nel 2015 MVRDV ha donato al Het Nieuwe Instituut ben 8 terabyte del proprio archivio progettuale, contenente ben 400 progetti, realizzati dal 1993 al 2008. Nel 2020 l’HNI ha allestito una mostra, MVRDVHNI The Living Archive of a Studio, per la quale MVRDV NEXT – un dipartimento interno che si occupa di ‘sviluppare processi computazionali e nuove tecnologie’ – ha predisposto MVRDV.Cloud, ‘un archivio che non si limita a raccogliere i progetti architettonici definitivi, ma presenta anche le informazioni relative al processo di progettazione in modo da poterle ordinare, esplorare e comprendere’. MVRDV ha quindi costruito un proprio ecosistema progettuale digitale, all’interno del quale ciascun progetto non viene mai inizializzato da zero e, soprattutto, non si conclude con la sua costruzione.

Inserito in questo modus operandi in cui ricerca architettonica e digitalizzazione procedono affiancate da più di 30 anni, “Rotterdam ROCKS!” è sfidante sotto alcuni aspetti. Da un lato sembra un grande divertissement – con quei sassi giganti impilati e coperti di verde e cascate artificiali – e dall’altro un oggetto di estrema complessità, derivato da ottimizzazioni funzionali complesse – comfort climatico, proliferazione del verde, tecniche costruttive a scocca e non trilitiche, ecc.. – che estendono il tecnico verso il naturale. MVRDV utilizza frequentemente strumenti digitali di ottimizzazione progettuale – di cui Carbonspace è un esempio – pertanto è ragionevole pensare che il progetto “Rotterdam ROCKS!” sia effettivamente complesso e informale, e che non sia per nulla irrazionale. La sua razionalità però non si palesa nelle immagini, che lo rappresentano invece come il risultato di un gesto compositivo basico (quello dell’impilare). La razionalità sembra risiedere in un ecosistema informatizzato esterno al progetto, in una rete invisibile di competenze, normative e tecnologie che permettono a quel gigantesco mucchio di pietre verdi di promettere al nostro sguardo una logica progettuale coerente.

L’edificio non è riconducibile né ad un tipo né ad una composizione di elementi misurati. La sua novità è informale e liminale rispetto ai canoni della costruzione, poiché non mostra chiaramente in che modo sia possibile realizzarlo. La forza dei render che lo rappresentano è però tale che il nostro sguardo, appunto, ne interpreta agevolmente la promessa: siamo disposti a investire la nostra immaginazione sulla tenuta logo-tecnica di questa proposta dello studio olandese. Non capiamo esattamente cosa sia o come sia – è una sensazione non misurabile – ma mantiene quella minima componente mimetica e antropometrica che ci consente di considerarlo ancora un edificio. Nonostante il render del progetto mostri che potrebbe essere costruito, la sua complessità è tale che non avremo altra alternativa che quella di affidarci alla competenza dei suoi progettisti e dei loro software.

In “Rotterdam ROCKS!” la rappresentazione sembra non avere più il compito specifico di duplicare l’edificio, limitandosi a descriverlo accuratamente. Essa ha soprattutto il mandato di mostrare ciò che l’edificio potrebbe essere, anche nei suoi aspetti meno normativi e più problematici. Tra quei sassi giganti emergono questioni che riguardano sia i processi progettuali che l’estensione dell’agency dei media digitali nel design.

La co-evoluzione tra rappresentazione e progetto: dall’aporia mimetica al diagramma

L’idea che il legame tra rappresentazione e progetto fosse bidirezionale è emersa con chiarezza in architettura nel corso del transito tra l’analogico e il digitale, nella complessa stagione della ricerca architettonica e filosofica tra gli anni ‘70 e gli anni ‘90 del secolo scorso. In quel periodo il decostruttivismo e il post-strutturalismo hanno sostenuto e alimentato una generale revisione dei processi di progettazione lineari e meccanici, a favore di due grandi filoni non-standard. Da un lato la decostruzione ha inteso liberare l’agency degli elementi della composizione e del discorso, attraverso assemblaggi discontinui. Dall’altro lato la topologia di derivazione organica ha voluto liberare l’oggetto architettonico dai meccanismi della produzione, reinterpretandolo come corpo continuo (Bredella 2022). Temporalmente, i due filoni sono in gran parte sovrapponibili, anche se le composizioni topologiche sono di fatto la prima espressione formale dell’utilizzo dei software digitali – e della rappresentazione su schermo – per la ricerca delle forme (form finding). E’ il concetto di diagramma ad aver costituito un punto di flesso notevole, tra un disegno ancora designatorio e un disegno invece esplorativo e combinatorio. Dobbiamo il concetto a Gilles Deleuze, che definisce il diagramma come ‘il culmine dell’astrazione, ma anche il momento in cui l’astrazione diventa reale’ (Deleuze & Guattari 1997).

Nel 2013, quando al MoMA ho visto nuovamente esposte alcune opere della vecchia mostra del 1988, Deconstructivist Architecture – si trattava di grandi tavole originali di OMA, Zaha Hadid e Peter Eisenman – mi resi conto che la tecnica di rappresentazione dei progetti era sia diagrammatica che descrittiva, connaturata a ciascun progettista e, in alcuni casi, anche solo al singolo progetto. Teoreticamente la decostruzione significava principalmente questo: rimettere ogni volta in discussione i rapporti tra autore e opera, nonché quelli tra linguaggio e realtà, per permettere alle opere di espandere la propria significanza oltre i limiti imposti dalle intenzioni del singolo autore o progettista. Ogni progetto era quindi un’esplorazione autoreferenziale, operata in una terra incognita, dove ogni gesto diventava rapidamente un gesto fondativo. Per raggiungere questa peculiare condizione, le tradizionali rappresentazioni del progetto – piante, prospetti, sezioni e veduta prospettica – andavano sostituite e rese più autonome attraverso inclinazioni, distorsioni, nuovi punti di vista. Per questo Hadid dipingeva, OMA usava collage e pittura, Eisenman colorava le sue assonometrie su carta da lucido al contrario. Il progetto e le rappresentazioni convergevano verso l’opera, ma da punti di esplorazione molteplici, e non necessariamente sovrapponibili.

come si è trasformato il nostro modo di progettare con la produzione e la diffusione digitale delle immagini?

Dal decostruttivismo in poi, rappresentazione e progetto hanno consolidato un rapporto di co-evoluzione attorno alle opere. Prima che entrasse in campo la produzione digitale di immagini, parte del lavoro di ricerca dei progettisti era dedicato all’elaborazione di un metodo di rappresentazione affine ai propri principi poetici. La riflessione sui rapporti tra gesto, segno e progetto – e la possibilità di rimodularli – era sintomo di quel tempo. Questa linea di ricerca riguardava dunque anche architetti non decostruttivisti, come Aldo Rossi, che utilizzava invece il disegno come dispositivo per semplificare radicalmente il linguaggio architettonico, confidando di riuscire in qualche modo di garantire la necessaria autoreferenzialità del progetto attraverso una rappresentazione più memoriale e ‘metafisica’.

Non è semplice raggiungere l’autoreferenzialità progettuale. Non è sufficiente affermare, come Koolhaas, fanculo il contesto (Koolhaas & Mau 1995). Esistono dei limiti normativi e costruttivi che stabiliscono connessioni irrinunciabili. Anche l’autoreferenzialità della rappresentazione è un percorso ad ostacoli. Sia che si tratti di testi che di immagini, essa ha dovuto bilanciarsi tra l’intenzionalità del soggetto e un certo obbligo alla somiglianza, un vincolo potentissimo per l’immagine. Possiamo chiamare aporia mimetica questa necessità di un mimetismo che tenga anche conto della libertà espressiva del soggetto. Significa che le immagini sono sempre costrette a somigliare, anche solo in minima parte, a qualcos’altro, e non c’è modo di evitarlo. L’aporia nasce dal fatto che le immagini devono costantemente bilanciare questo debito di somiglianza verso la realtà con l’affermazione della propria autonomia visiva. Uno sbilanciamento, in un verso, significherebbe ridondanza visiva – con un’immagine troppo simile al reale – mentre nell’altro porterebbe ad un principio di surrealismo – con un’immagine incoerente rispetto al reale, in quanto troppo autoreferenziale.

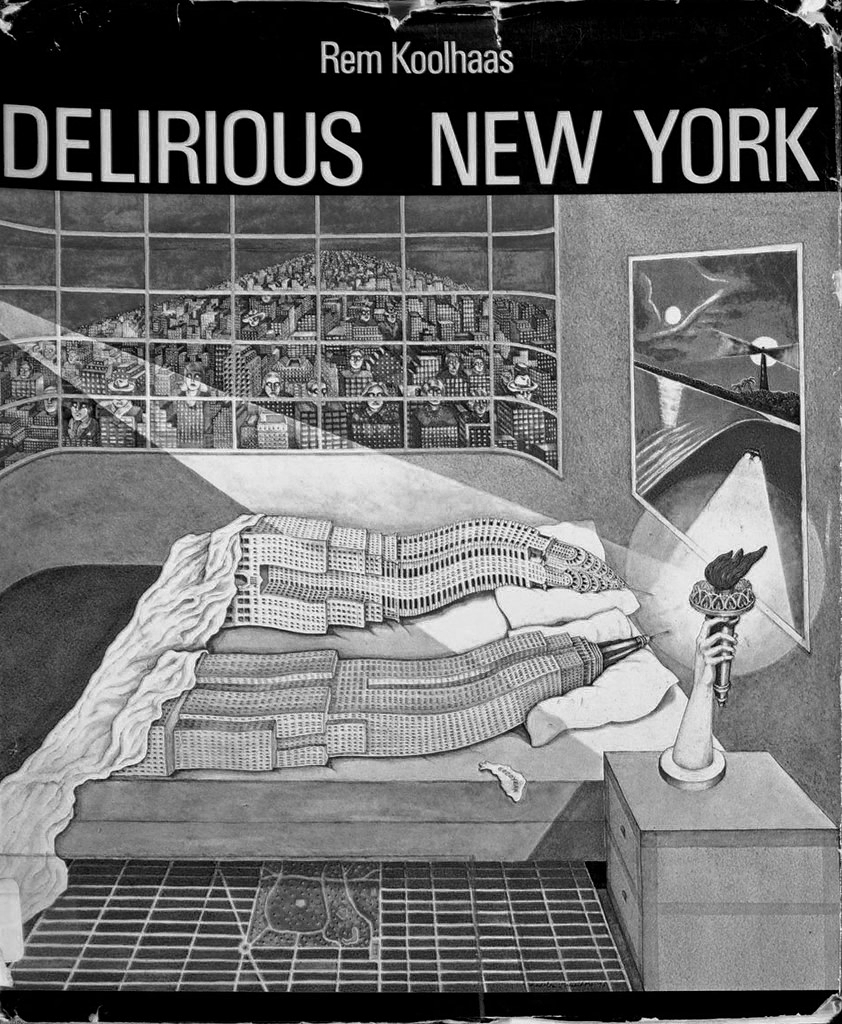

Gli architetti decostruttivisti avevano inteso bene questa dinamica. E si proposero di uscire dalla mimesi attraverso la produzione di immagini con il giusto grado di astrazione, che stimolasse così uno sguardo ormai assopito in ripetizioni canoniche dei tipi architettonici. Alcuni esempi furono i grattacieli umanizzati in Delirious New York, le prospettive pittoriche di Zaha Hadid o le partiture spaziali dei Chamberworks di Daniel Libeskind.

La tecnica del collage – ne accenno qui solo come esempio – mostra, forse ancora più chiaramente, come un utilizzo strategico dell’aporia mimetica possa catturare lo sguardo, attraverso la potenza evocativa dei singoli elementi della composizione, ricomposti però in nuove figure, attraverso processi di decontestualizzazione/ri-contestualizzazione che rimangono visibili grazie ai bordi delle figure.

Nelle rappresentazioni progettuali analogiche e pre-digitali – fino alla seconda metà degli anni ‘90 del secolo scorso – questa sfida al mimetico era parte connaturata del processo di design, una delle modalità di sottolineare quanto le cose, soprattutto le cose progettate, potessero essere differenti dalla natura e dal suo implicito carattere normativo. L’aporia mimetica è stata oggetto di un lungo processo di decostruzione, che alla fine è riuscito nell’intento di rendere le immagini molto più autonome rispetto all’obbligo di somiglianza.

Quanto è cambiato tutto questo dopo qualche decennio di uso dei nuovi media nei processi di progettazione e rappresentazione del reale? Come si è trasformato il nostro modo di progettare con la produzione e la diffusione digitale delle immagini? Le mie domande si basano sull’ipotesi che, nel design di architettura, la rappresentazione sia ancora parte del processo di elaborazione del progetto, anche se nell’elaborazione delle immagini le prassi artigianali e analogiche sono state (quasi) completamente sostituite da quelle digitali. Esiste ancora una lotta nei confronti del mimetico? La risposta a cui sono giunto è: non più, perché si è trasformata in qualcosa di più complesso. Siamo riusciti in qualche modo a svincolare le immagini dall’obbligo al mimetismo, passando dalla rappresentazione alla simulazione, ma poi, più di recente, nel passaggio da simulazione a generazione con sistemi AI, la coerenza stessa delle immagini ha iniziato a mutare. Dato lo stretto legame tra rappresentazione e progetto, ritengo che questa mutazione stia interessando non solo i processi progettuali, ma anche altri punti del loro correlato (il contesto, le tipologie, le tecniche costruttive). Per tracciare una bozza di questo percorso, è necessario fissarne alcune tappe, entrando nel merito delle tecniche di rappresentazione, in cui si nidificano, soprattutto nel passaggio dall’analogico al digitale, alcune questioni fondative. Solo in seguito potremo dedicarci ai modi in cui il design usa, oggi, le immagini digitali e di sintesi – intendo quelle generate attraverso sistemi AI – per annotare qualche appunto sulla situazione attuale della progettazione.

Conoscere per immagini: tra somiglianza e interpretazione

La prima di queste tappe riguarda il modo in cui le immagini producono conoscenza, e la tensione costitutiva tra somiglianza e interpretazione che le attraversa. Quando guardiamo un’immagine, avviene uno scambio simbolico e semiotico che in larga misura è un condensato culturale vecchio di millenni, che riguarda il modo di produrre cultura ma soprattutto il modo in cui trasportiamo ed utilizziamo i contenuti di conoscenza. Il nostro rapporto con la realtà è oramai primariamente visivo. La vista ci dà molte informazioni complesse sull’ambiente, e la luce è sempre stata usata come simbolo di verità e conoscenza. I campi semantici dell’illuminazione e dell’oscuramento descrivono la nostra azione conoscitiva sul reale. Tuttavia, quando tra noi e il reale si frappongono le immagini, il filtro tra conoscenza e realtà in qualche modo diviene meno trasparente, in quanto indiretto: non vediamo il mondo, ma la sua rappresentazione. Fin dalle loro origini le immagini hanno aperto un vasto campo problematico, nel contendere alla scrittura l’esercizio della rappresentazione del mondo. La questione è basilare: il mondo reale è così difficilmente trasportabile dentro ai laboratori di ricerca e così ricco di informazioni (nonché continuamente soggetto a modifiche) che ci è più comodo utilizzare delle sue rappresentazioni, che sono più semplici e di dimensioni ridotte (nonché solitamente bidimensionali). Secondo un certo principio di coerenza ottica – ne parla (Latour 1990) – le rappresentazioni sono pertanto trasportabili. Le procedure veritative che le utilizzano – epistemologia in primis – sono state in certa misura configurate a posteriori così da renderle massimamente efficienti: le rotte si tracciano su mappe, le costruzioni si basano su disegni esecutivi, la conoscenza scientifica si trasmette attraverso paper, e così via. Diagrammi bidimensionali, testi, disegni e mappe fanno sì che due dimensioni vengano istituzionalmente considerate sufficienti per conoscere e controllare il reale.

‘(un’immagine) può e deve essere interpretata, ma non può essere letta (…). Non si dà percezione senza interpretazione. Non c’è un grado zero dello sguardo’.

Régis Debray, 1999

Certo, possiamo catalogare diversi tipi di immagini e diversi tipi di testi, ciascuno con un proprio grado di affinità con il referente: un paper scientifico può essere più coerente di un resoconto di viaggio o di un romanzo, mentre un paesaggio dipinto potrebbe risultare meno dettagliato di una fotografia. Ma dalle due dimensioni riusciamo sempre a ricavare qualcosa di utile perché coerente e significativo.

A questo punto devo essere più specifico, iniziando a distinguere il testo dall’immagine. Per quanto si possa parlare di ‘immagini letterarie’ – come ad esempio nelle metafore – l’esperienza dell’immagine fornisce informazioni diverse dall’esperienza linguistica. L’immagine, infatti, è fonte di ‘rappresentazioni analogiche degli oggetti’, mentre il testo derivato dalla verbalizzazione tende ad essere ‘sostitutivo del reale attraverso i segni convenzionali e astratti della lingua’ (Wunenburger 1999). Dal punto di vista cognitivo, ‘la visione, nella sua globalità, coinvolge il soggetto molto più intensamente della verbalizzazione, che necessita (invece) di un apprendistato, di una scoperta progressiva’. (ibid.). Mentre il testo è il prodotto di una lingua – con grammatica e sintassi che regolano la prima e la seconda articolazione di monemi e fonemi – l’immagine ha un carattere di istantaneità, che non è scomponibile nei propri elementi costitutivi se non come tracce indagabili solo dopo che l’immagine è stata prodotta. Dice bene Régis Debray quando afferma che ‘(un’immagine) può e deve essere interpretata, ma non può essere letta (…). Non si dà percezione senza interpretazione. Non c’è un grado zero dello sguardo’. (Debray 1999). Di fronte ad un’immagine abbiamo quindi bisogno di un contesto interpretativo, cosa che nel testo è solitamente una condizione non necessaria, proprio grazie alle strutture logiche e ai significati che sostengono la produzione linguistica. L’interpretazione di un’immagine è relativa, a seconda di cosa stiamo guardando. Nel caso di diagrammi scientifici, ad esempio, la rappresentazione richiede il minimo di interpretazione. Ma di fronte ad un quadro – intendo un’opera d’arte – l’interpretazione è molto più complessa, come ha dimostrato Michel Foucault nella sua famigerata analisi del quadro Las Meninas di Velasquez (Foucault 1967)

Diversamente dal testo, nell’immagine-opera spunta infatti una nuova complicazione: quella della tecnica con cui è stata realizzata. Si tratta, a ben vedere, di un insieme di questioni, tutte orbitanti attorno ad un nucleo di materia particolarmente oscura. Nell’immagine-opera, infatti, la tecnica di rappresentazione non può essere ignorata. Possiamo sintetizzare questo groviglio con una singola domanda: come posso essere sicuro del tipo di conoscenza che proviene dall’immagine-opera se quella stessa opera è stata fabbricata interamente da me? Non corriamo il rischio di perderci in un pozzo di autoreferenzialità? Non esistono soluzioni senza conseguenze filosofiche, purtroppo. Platone era propenso a non correre questo rischio, preferendo non fidarsi mai delle rappresentazioni. Heidegger è stato invece più possibilista, affermando che la tecnica, nella cultura greca, non implicava (solo) un operare pratico ma era anche una modalità del sapere (Heidegger 2002). Quindi, per il filosofo tedesco, era possibile considerare l’immagine-opera come fonte di conoscenza, in quanto attraverso la tecnica, la rappresentazione apriva uno squarcio di visibilità sul mondo.

Fotografia e cinema: dall’illusione del referente all’autonomia dell’immagine

Cosa cambia di questa impostazione quando passiamo dal quadro alla fotografia? Oppure al cinema? Per quanto si tratti di tecniche di rappresentazione estremamente mimetiche, fotografia e cinema operano ai bordi del linguaggio (Laura U. Marks 2000). Il contributo della tecnica si fonde con l’immagine prodotta, fino a svanire oltre i bordi delle immagini, rivelandosi solo ad occhi esperti, in grado di cogliere, ad esempio, l’uso di determinate focali, di punti di vista, di filtri, e di quant’altro ancora. Comprendere un’immagine fotografica o cinematografica fa emergere con forza il ruolo interpretante dello spettatore. Questo è il punto centrale della ricerca di Roland Barthes sulla letteratura e sulla fotografia. Diversamente da un testo, ‘ogni fotografia è un certificato di presenza’ che documenta il suo tempo, rappresentandolo però come un ‘senza avvenire’. Infatti, per Barthes, ciò che appare in una foto ‘è stato’ (Barthes 2003). Pertanto, in una fotografia, ci illudiamo di poter accedere facilmente alla concretezza del suo referente – un paesaggio, un oggetto, una persona – ma è, appunto, solo un’illusione. Forse perché ‘per noi occidentali, ciò che è nascosto è più vero di ciò che è visibile’, la fotografia ‘non sa dire ciò che non dà a vedere’. La bordatura di un’immagine fotografica è quindi la sua parte più problematica, in quanto è proprio in quel limite che la mimesi si sfilaccia, pur tentando di mantenere la presa sulla nostra immaginazione di spettatori, anche quando spostiamo il nostro sguardo oltre quel bordo. La foto, in quanto immagine, continua ad avere una funzione duplice: mima la realtà, e simultaneamente la nega per lasciare spazio alla nostra interpretazione o alla nostra immaginazione.

la fotografia ha permesso alle immagini di rendersi autonome rispetto al loro referente, poiché riescono efficacemente a portarlo con sé

Nella sua illusione di certezza, la foto è un’esteriorità senza intimità (non possiamo, dice Barthes, semplicemente voltarla per scrutare ciò che sta sul lato invisibile) e porta ad una sospensione dell’interpretazione. Sembra quindi che per l’immagine-foto non valga quello che Heidegger auspicava per l’immagine-opera, probabilmente perché l’aporia mimetica è ancora più forte. Nelle ultime pagine del suo pamphlet, Barthes arriva così ad affermare che la fotografia si avvicina alla follia, proponendoci di interpretare la fotografia come una forma di allucinazione ‘falsa a livello della percezione, vera a livello del tempo’. Possiamo scorgere, nel testo del critico francese, alcune eco di quanto scritto circa quindici anni prima da Marshall McLuhan a proposito della fotografia. Il sociologo canadese aggiunse tuttavia alcune ulteriori considerazioni, valutando la fotografia all’interno della sua interpretazione dei media. La fotografia segna il passaggio dall’uomo tipografico all’uomo fotografico. La luce e la chimica nella tecnica fotografica ci hanno portato a superare la meccanica, preparandoci per l’elettronica. Inoltre, per McLuhan, se l’alfabeto fonetico aveva scisso la parola parlata dal suono e dal gesto, la fotografia (ma soprattutto il cinema) hanno restituito il gesto alla tecnologia umana (McLuhan 20002). L’idea di una percezione ‘corporea’ delle immagini è stata fornita da Gilles Deleuze e Félix Guattari, e ripresa da Laura U. Marks nella sua analisi del tipo di percezione che avviene nel cinema. Si tratterebbe di una ‘percezione prensiva’ – cioè aptica più che ottica – adatta ad ‘uno spazio intensivo, più che estensivo, di distanze e non di misure’ (Deleuze & Guattari 1997).

La fotografia, in sintesi, ha permesso alle immagini di rendersi autonome rispetto al loro referente, poiché riescono efficacemente a portarlo con sé, anche se illusoriamente. Non significa che le foto siano false in ciò che rappresentano, ma che quello che rappresentano non è più presente. Per la fotografia quello che viene fotografato non è (più) perché, più propriamente, è stato. Non per nulla, quindi, i fotografi anglosassoni – da buona tradizione empirista – parlano di shooting quando descrivono lo scatto fotografico: è un termine che ricorda il tentativo di uccisione di una preda, cioè il reale stesso. La fotografia tramanda così il senso sacrale originario della imago, il suo rapporto con la morte. È la stessa morte documentata dal fotografo protagonista nel film Blow Up – interpretato da David Hemmings – e che rimane effimera nonostante la fotografia. Il protagonista, accortosi di aver fotografato per caso i piedi di un corpo supino nel parco, non ha altre tracce per (di)mostrare che essi appartenevano ad un morto. L’invisibile vince così sul visibile, ed anche il fotografo è costretto a prenderne atto, partecipando alla finzione di una finta partita di tennis tra mimi. Alla fine del film Hemmings recupera una palla da tennis invisibile, e la lancia nel campo dei mimi.

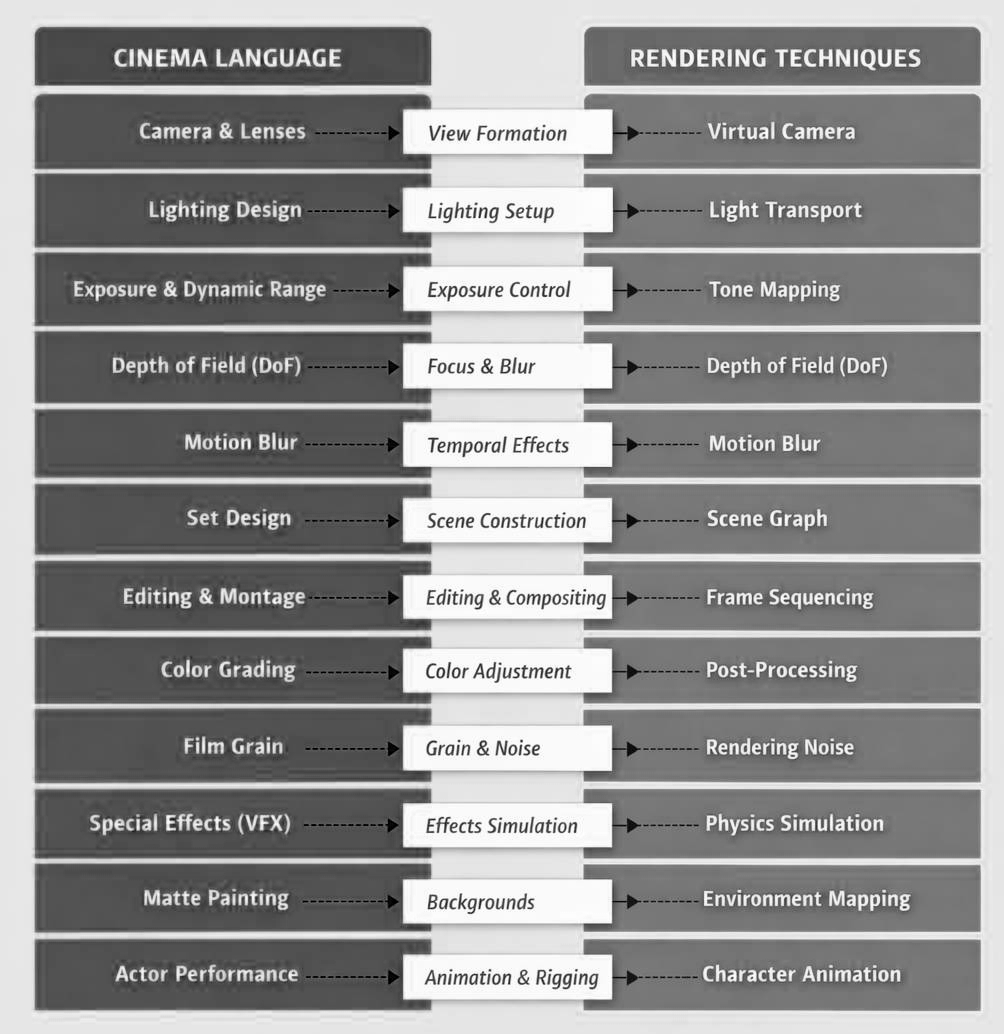

Prendendo spunto dal film di Antonioni, possiamo dire che il vero antesignano concettuale del rendering non è però la fotografia ma il cinema. Le analogie semantiche tra le procedure cinematografiche e quelle del rendering sono numerose e dimostrano come entrambe queste tecniche si focalizzino sul medium – la luce e la percezione – e non (più) sugli estremi della rappresentazione – la realtà da un lato e il soggetto dall’altro – in quanto essi vengono introiettati nei processi stessi. Questo perché cinema e rendering possono entrambi operare in uno spazio controllato, costruendo consapevolmente un simulacro di realtà.

Il cinema: dal simulacro analogico all’archivio digitale

Nel cinema non si tratta di catturare più nulla, ma di accettare l’illusorietà dell’immagine in movimento e, anzi, di farne il fulcro di una completa autoreferenzialità del segno. Per questo le tecniche di rappresentazione dovranno essere particolarmente coerenti e rivolte allo sguardo di uno spettatore culturalmente ben definito. L’interazione tra l’intenzione del soggetto-autore e l’interpretazione del soggetto-spettatore si fa tuttavia più lieve rispetto alla fotografia – ragione per cui Bergson non vede il cinema di buon occhio. Dal canto suo, un cineasta estremamente critico come Lars Von Trier, che con i manifesti di DOGMA della fine degli anni ‘90 ha evidenziato alcune delle problematiche del passaggio dal cinema analogico al cinema digitale, ha spinto nella direzione di una generale liberazione dell’opera cinematografica dalle pastoie dell’autorialità del regista (operazione analoga a quella compiuta da Barthes con la morte dell’autore). Per dare un corpo all’opera, LVT stravolge i canoni dell’illuminazione delle scene, quasi azzerando la loro fotografia. Le immagini si fanno granulose, imprecise, e ribaltano il rapporto tra visibile e invisibile – come accade per i fantasmi di The Kingdom o per l’immaginario di Selma in Dancer in the Dark. L’inquadratura cinematografica diviene più spinta, più ravvicinata, più aptica, diviene puntamento. ‘Puntare è andare verso qualcosa’ dice LVT. Il cineasta danese mostra come l’opera cinematografica possa diventare un’esplorazione senza autore, senza dunque pretendere di divenire arte o di confrontarsi mimeticamente con la realtà (Porcelli 2001). Il cinema può muoversi di lato, sottrarsi alle faticose procedure di verifica di una rappresentazione vincolata alla conoscenza. L’autonomia dell’immagine, dopo l’autonomia del testo, è così finalmente compiuta. Ma è stata possibile solamente attraverso la costruzione di un preciso sguardo ben alfabetizzato, quello di uno spettatore immobile, con lo sguardo fisso. ‘Soltanto una società estremamente alfabeta e astratta impara a tenere gli occhi fissi’, ha scritto McLuhan. Il ruolo dello spettatore è limitato ad avallare l’illusione di realtà finale da parte del simulacro.

il simulacro digitale non è più costretto a usare il mondo come referente, in quanto può contare su innumerevoli database che costituiscono il suo referente astratto

Il rapporto tra digitale e cinematografico è profondo, in quanto entrambi costruiscono memorie esterne che sono determinanti per il loro stesso funzionamento. Essi fanno uso di maggiori quantità di informazioni rispetto alla fotografia, e hanno la necessità di archiviarle in modo da poterne avere accesso immediato. Il 1936 sembra essere stato un anno centrale per entrambe le tecniche. Mentre veniva pubblicato On Computable Numbers di Alan Turing, l’ingegnere tedesco Konrad Zuse costruiva il primo computer a Berlino, usando come nastro perforato di controllo una pellicola di scarto da 35 mm. Scrive Manovich: ‘la macchina cinematografica assomiglia al computer per un aspetto fondamentale, anche il programma e i dati di un computer devono essere immagazzinati da qualche parte’ (Manovich 2002). Le informazioni vengono archiviate, accumulate in database che rappresentano, nel passaggio al digitale e poi all’epoca informatica, ciò che è stato. Questo vasto deposito è la principale risorsa a cui possono accedere le rappresentazioni digitali. Si tratta del già sentito – come lo chiama Mario Perniola: un deposito di elementi spuri – oggi per la gran parte digitalizzati – che, secondo il filosofo astigiano, hanno ulteriormente addomesticato il sentire umano. ‘Dispensare l’uomo tanto dalla partecipazione quanto dall’indifferenza, tanto dalla sensibilità quanto dall’insensibilità, liberarlo dalla fatica, dallo sforzo, dalla responsabilità, dall’attenzione, dalla scelta, dall’applicazione, sottrarlo tanto all’enorme dispendio di energie consumate nel sentire, quanto all’enorme spreco di oggetti, di persone e di avvenimenti passati senza essere sentiti, questa è la grande svolta storica di cui siamo testimoni’ (Perniola 1991). Il simulacro digitale non è più costretto a usare il mondo come referente, in quanto può contare su innumerevoli database che costituiscono il suo referente astratto – molto più omogeneo e coerente del vecchio referente. Saranno questi vasti archivi di informazioni ad essere determinanti per la generazione di immagini, attraverso sistemi AI addestrati per esserne lettori/spettatori artificiali.

Una tassonomia delle immagini digitali: immagini poietiche, virtuali e mediatiche

Quando l’immagine viene usata come medium digitale presenta ontologie più spurie, che non possono essere univocamente ricondotte ai canoni della pittura, della fotografia o del cinema. La riproduzione continua e l’elevata diffusione nelle reti (principalmente digitali) impongono alle immagini di adattarsi ai contesti d’uso, pur facendosi portatrici di un certo ordine normativo – per inquadratura, composizione, raffigurazione, ecc.. E’ infatti la caratteristica del medium quella di conformare i significati. In questo senso il medium è il messaggio: il medium è di per sé un significante, e altera il significato che porta con sé. Se osserviamo i render più fotorealistici, notiamo come tendano a normalizzare i canoni degli altri media, componendoli in immagini adatte ad uno sguardo alfabetizzato. Il realismo dell’immagine digitale, infatti, è relazionale: lo sguardo dello spettatore e le componenti dell’immagine – simulazioni di forme e di fisiche dei materiali – convergono nel sostenere l’ontologia del simulacro. Accade anche per “Rotterdam ROCKS!”: il contesto urbanizzato, i punti di vista ad altezza spettatore, la golden hour della rappresentazione, sono aspetti normativi che il nostro sguardo percepisce implicitamente, fornendo credibilità al render. Il ruolo del soggetto è quindi proattivo. Egli investe il proprio sguardo – ciò che ha imparato e memorizzato – sull’immagine digitale, fornendole credibilità. In altre parole l’immagine rimane riconoscibile per lo sguardo, anche se rappresenta qualcosa di completamente nuovo. L’immagine può muoversi all’interno di questa bordatura, tra l’immaginario e il simile, a seconda di come venga usata. Per descrivere i principali modi d’uso propongo dunque una semplice suddivisione in tre categorie, per quanto le immagini tendano ad attraversare continuamente queste bordature interpretative.

quando usiamo un’immagine mediatica stiamo proponendo anche un implicito set di norme correlate

La prima è quella dell’immagine poietica, che mantiene ancora un rapporto di verosimiglianza con il reale. In questo caso ‘(l’immagine) ha la proprietà di riprodurre qualcosa, di replicare il reale, pur essendo altra da esso, e di essere nello stesso tempo assenza o negazione della realtà rappresentata’ (Wunenburger 1999). L’immagine poietica usa il simile per condurci al di là di esso, mettendo a rischio la sua stessa unicità. ‘Se esistessero processi di riproduzione perfetta, identica, questi metterebbero in pericolo l’immagine stessa, vale a dire che renderebbero quasi impossibile la sua identificazione come immagine’ (ibid.). Dobbiamo a Ernst Cassirer l’idea che il mimetismo funzioni come una soglia, attraverso la quale si possa superare una rappresentazione passiva del dato per spingersi nell’espressivo, ‘situato a mezza strada tra il reale e l’ideale, tra l’oggettivo e il soggettivo’ (ibid.). L’uso principale dell’immagine poietica è quello della somiglianza.

La seconda categoria di immagini è quella dell’immagine virtuale, in senso bergsoniano. Per Bergson l’immagine è legata alla durata e alla memoria. La nostra memoria e la nostra percezione, secondo il filosofo francese, sono fondate, rispettivamente, su immagini-ricordo e percezioni-immagini (Deleuze 2001). Le prime assomigliano molto alle fotografie di Barthes: costituiscono un passato compiuto e ontologicamente valido, una ‘memoria ontologica, capace di servire da fondamento allo svolgimento del tempo’ (ibid.). Nel presente le percezioni-immagini coesistono con le attualizzazioni delle immagini-ricordo, racchiuse in un passato ontologicamente coerente, che Bergson definisce virtuale. La durata bergsoniana è l’esito di questa coesistenza, con immagini in continuo transito tra virtuale e attuale. Il processo di attualizzazione non va però confuso con quello di realizzazione. Mentre questo implica una limitazione del possibile attraverso la somiglianza, quello si basa su regole di differenziazione e creazione, sulla differenza tra il virtuale da cui si parte e gli attuali a cui si arriva (ibid.). L’uso principale dell’immagine virtuale è quello dell’attualizzazione.

La terza categoria richiede una trattazione più ampia, poiché è quella che più direttamente riguarda il render e i processi progettuali digitali. Inoltre è anche quella più complessa, perché si sofferma su l’implicito carattere normativo delle immagini: è quella dell‘immagine mediatica. Ha scritto McLuhan che ‘attraverso la simulazione tecnologica il processo creativo di conoscenza sarà collettivamente esteso all’intera società umana, proprio come tramite i vari media abbiamo esteso i nostri sensi e i nostri nervi’ (McLuhan 2002). Per il sociologo canadese il medium è l’estensione di noi stessi, ma questa considerazione va contestualizzata e ampliata, in quanto limitata alla comunicazione, intesa da McLuhan come caratteristica principale della nostra società. Poiché stiamo esplorando un utilizzo delle immagini nel progetto, possiamo cercare di definire il medium in altro modo. Diversamente da quanto accade per le immagini poietiche e le immagini virtuali, le immagini mediatiche operano con molto meno contesto a disposizione. Le immagini mediatiche includono quindi i simulacri digitali, in cui la coerenza è completamente interna. Le immagini mediatiche sono portatrici proattive di ordine, lo stesso che abbiamo intuito guardando i render di “Rotterdam ROCKS!”. Questa loro caratteristica è implicita nell’uso della radice *med-, per quanto ricostruito da Emile Benveniste a partire dagli usi delle lingue indoeuropee (Benveniste 2001). *med- indica sostanzialmente un ‘riportare alla norma’, attraverso l’uso di una misura appropriata per risolvere una situazione problematica, turbata, in disordine. La mediazione ha dunque un senso originario legato alla risoluzione di una situazione anomala (del tipo: quell’edificio fatto di massi finti giganti e sovrapposti è davvero costruibile?), il che ci porterebbe a considerare l’immagine mediatica come uno strumento per la normalizzazione e l’ordinamento. In altre parole, quando usiamo un’immagine mediatica stiamo proponendo anche un implicito set di norme correlate, che, per sintesi, possiamo chiamare capitale semantico (Floridi 2018). Il capitale semantico, tuttavia, in questo caso non funge da archivio dei significati condivisi, quanto da catalogo di norme per la significanza, cioè di quelle conformazioni – tipiche delle culture – da impiegare per la costruzione di simulacri che siano significanti. L’uso principale dell’immagine mediatica è quello della mediazione.

Il render: dalla cattura alla costruzione del reale

Ho già anticipato qualche riflessione sul render, soprattutto per descriverne la genealogia a partire da fotografia e cinema. Quanto mi preme ora è di definire in cosa la renderizzazione è differente dagli altri media. Etimologicamente, render deriva dal latino reddere (restituire), passando per il francese antico rendre e l’inglese del 14° secolo renden / renderen (fornire). Oggi l’uso della parola include anche i significati di interpretare e trasformare. Ma render appartiene anche al campo semantico della costruzione, in quanto indica lo strato di finitura superficiale (visibile) dei materiali, come l’intonaco cementizio, o cement render, e l’intonaco di calce, o lime render. Viene abbandonata la metafora della caccia nelle inquadrature, nelle riprese e nei puntamenti, a favore di una nuova idea di produzione-costruzione del reale nell’immagine renderizzata. Questo debito semantico nei confronti del gesto costruttivo costituisce la base di un’illusorietà ancora maggiore, rispetto a quelle di fotografia e cinema. Si tratta di un incontro consensuale, che deborda, a ritroso, sulla realtà stessa. In altre parole, l’illusione di realtà dei simulacri digitali ibrida la rappresentazione con la costruzione, al punto che il render può risultare più reale del reale.

Un ulteriore corollario a questa illusione di realtà emerge nel momento in cui il render entra nelle discipline del design, e principalmente nell’architettura. Il render, facendo affidamento su uno sguardo sempre più specializzato, può mostrare realisticamente una realtà non costruibile, ma parimenti coerente.

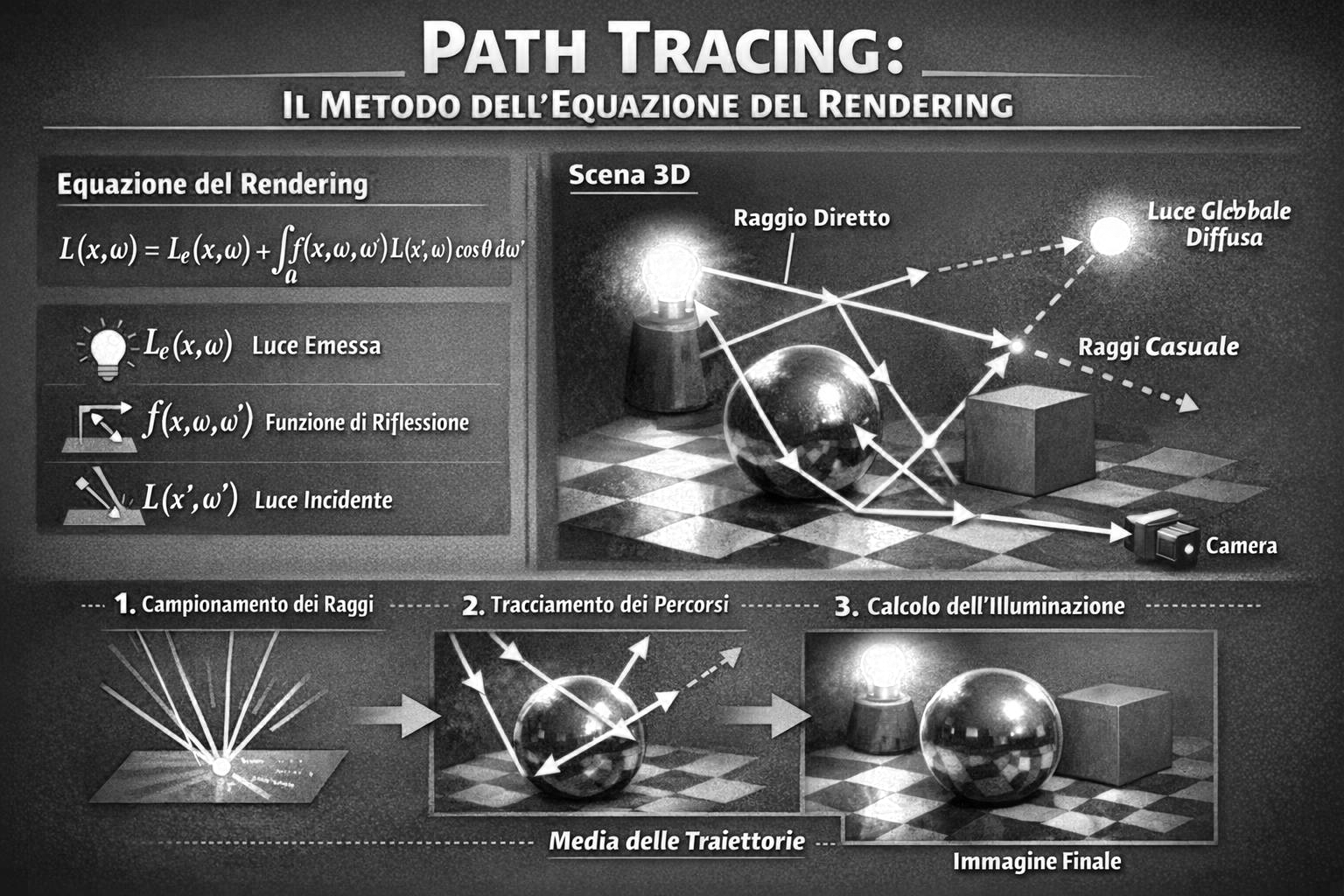

Nell’ambito della computer grafica, il nome render deriva dall’equazione di rendering presentata da David Immel e da James Kajiya nel 1986. L’equazione calcola la quantità di luce che arriva sul punto di una superficie virtuale (o mesh) come somma dei contributi di luce diretta e di luce riflessa dalle altre superfici.

La risoluzione dell’equazione è la finalità di ogni rendering che intenda essere fotorealistico, anche se la quantità di calcoli necessaria per una completa aderenza al reale è incredibilmente elevata. Per via della conservazione dell’energia, infatti, nella realtà la luce continua ad essere riflessa . Per questo, sono stati elaborati metodi di risoluzione che sostanzialmente riducono la complessità dei calcoli in funzione della nostra capacità di percepire i dettagli di quanto renderizzato. E’ dunque il nostro modo di percepire – o, se preferite, il modo in cui il nostro sguardo è stato addestrato – a determinare il modo in cui il render viene prodotto. Gli algoritmi che semplificano i calcoli dell’equazione di rendering sono certamente necessari per una maggiore efficienza nel calcolo. Potremmo definirli euristiche di rendering, e sostanzialmente si basano su campionamento stocastico dell’integrale dell’equazione. I più noti sono derivati dal metodo Monte Carlo: path tracing, bidirectional path tracing, Metropolis Light Transport (MLT). Ma esistono anche altri metodi, basati su altre tecniche di campionamento come MIS e photon mapping. In tutti i casi, il costo computazionale non viene sostenuto per avvicinare il render alla realtà, ma per condurlo verso lo sguardo dell’utente. In sintesi: occorrono più calcoli per un realismo veritativo e (molti) meno calcoli per un realismo credibile.

Diversamente da fotografia e cinema, lo shooting non è più necessario: nel digitale, il rendering è una rappresentazione fatta in cattività, e nessun elemento del reale deve più essere catturato o ucciso. Il render dunque annulla definitivamente l’aspetto sacrale originario. Era questo che, secondo Debray, accomunava i fondamenti della rappresentazione: ‘(l’imago era) il calco in cera del viso dei morti, che il magistrato portava ai funerali (…). L’immagine attesterebbe il trionfo della vita, ma un trionfo conquistato sulla morte, e meritato tramite essa. (…) Segno deriva da sema, pietra tombale. (…) Il segno in cui si riconosce una sepoltura precede e fonda il segno di somiglianza’ (Debray 1999).

Il render digitale accompagna l’evoluzione del nostro sguardo, sempre più vagante e in attesa di dispositivi di cattura della nostra attenzione, con euristiche di rendering in grado di limitare sempre più i costi computazionali. Per questo, quando Debray descrive le conseguenze dell’eccesso di visibilità determinato dalle immagini digitali, propende verso un’interpretazione negativa, scrivendo che ‘quando si vede tutto, non vale niente (…) la somiglianza come ideale porta dentro di sé un virus devastante di rassomiglianza’.

Tuttavia, se seguiamo l’emancipazione dell’immagine digitale dalle pastoie dell’aporia mimetica originaria, possiamo arrivare a considerare una coevoluzione tra lo sguardo e il visibile quello che per altri, come per Debray, è un preoccupante eccesso di visibilità.

La rappresentazione disordinata: quattro caratteristiche

L’azione mediata delle immagini digitali sulla rappresentazione e sulla conoscenza del mondo è tutt’altro che trasparente. Inoltre la diffusione delle immagini digitali ha raggiunto un’elevata intensità: sparse nelle reti globali, esse dirottano i significati, attirano gli sguardi, nidificano metafore. L’aporia mimetica, definitivamente decostruita, rimane solamente come possibilità – le immagini digitali possono ancora somigliare – ma non sembra più essere una condizione necessaria alla loro esistenza e significanza. Il loro referente è un sistema significante diffuso in archivi esterni all’immagine, ma anche esterni al mondo. Le correlazioni che sostenevano la veridicità della rappresentazione – ad esempio nei contesti scientifici – sono affidate a sistemi esperti che gestiscono gli accessi ad archivi digitali. E’ una condizione inversa a quella che Fredric Jameson aveva rilevato per il postmoderno: siamo talmente immersi nelle immagini che la distanza critica può svelarsi in tutta la sua incommensurabilità. Non solo non possiamo valutarle criticamente perché sono troppo vicine, ma ci accorgiamo che la possibilità di farlo non esiste nemmeno più, perché il loro referente è volato via, in archivi irraggiungibili, di cui non possiamo avere conoscenza. Ad esempio, nel caso della realtà aumentata che non opera per sostituzione ma per sovrapposizione tra reale e simulato, l’immersione tra immagini è fattuale, non solo concettuale. Inoltre con la realtà virtuale che permette all’aptico di sovrapporsi all’ottico, sperimentiamo una dissociazione tra la propriocezione e la percezione visiva: ciò che vediamo è elaborato altrove – da render farm che ci inviano un flusso costante di frame, come accade nelle piattaforme di gaming.

dovremo abituarci ad un tipo di utilizzo delle immagini di questo tipo, sovrapposta al reale, estemporanea, on-demand

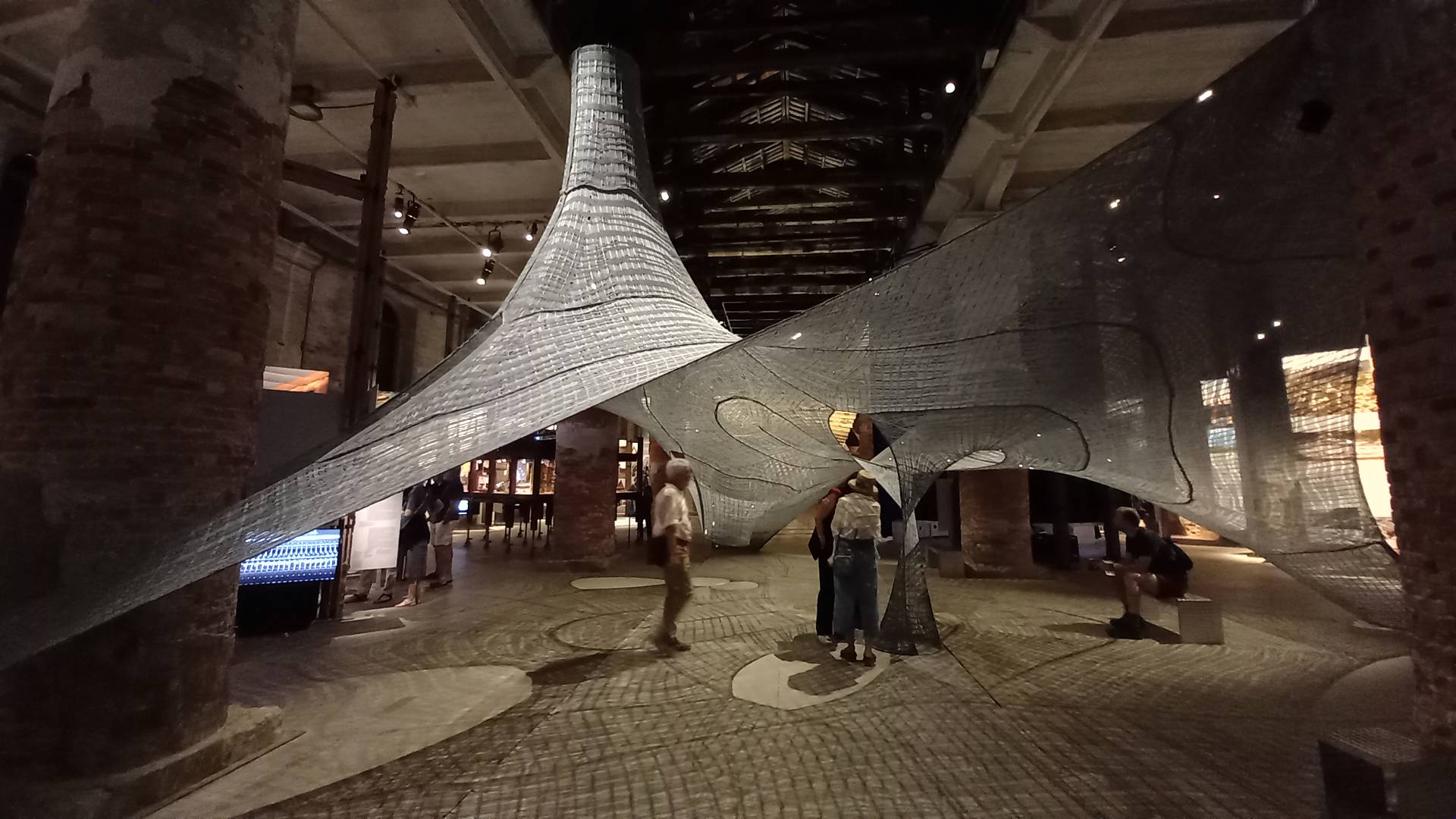

Il carattere normativo dell’immagine digitale è quindi solo un riflesso, predisposto per il nostro sguardo, per l’ultima illusione di vedere e capire. Ma quello che realmente accade negli archivi digitali o nei centri di elaborazione, cioè il vero referente di cui dovremmo occuparci, è di fatto invisibile. Ne deriva la sovrapposizione tra ordine locale – la composizione dell’immagine – e l’invisibilità dell’ordine degli archivi globali. Nel campo del design di architettura, questa ulteriore decostruzione del significante e del percepito ha probabilmente un impatto minore, per ora. Nell’architettura, la costruzione ha ancora un peso maggiore rispetto alla rappresentazione, ciò non toglie che in molti casi il doppio digitale venga utilizzato per verificare dettagli esecutivi in fase d’opera, a volte mediante sovrapposizione tramite AR (come nel caso delle operazioni di scavo relative alla realizzazione del ristorante-casa dell’architetto Junya Ishigami, in Giappone). Dovremo abituarci ad un tipo di utilizzo delle immagini di questo tipo, sovrapposta al reale, estemporanea, on-demand. E’ un problema che le estetiche e le esposizioni museografiche attuali hanno già dovuto affrontare.

Mi riferisco all’attenzione disordinata definita da Claire Bishop (Bishop 2024) in merito all’impatto che internet e i social media hanno sull’attenzione dello spettatore. Questo riguarda, per quanto collateralmente, anche il progetto di architettura. Occorre tener conto infatti di quanto oggi l’aspetto pubblico degli edifici non possa essere limitato al loro esser parte o meno ai fatti urbani primari – come i tracciati stradali, i quartieri o i monumenti. Grazie ai social media, parte delle immagini legate alla progettazione e al costruito, vengono tradotte in iconografia di ampia distribuzione. Questo sviluppa in modo esponenziale l’immagine della città, secondo punti di vista prospettici e soggettivi, con sguardi umani o artificiali – ad esempio nel caso di riprese effettuate con droni. Queste rappresentazioni si sovrappongono alle tradizionali vedute ortografiche tipiche dei fatti primari (planimetrie, piante, prospetti e sezioni). E’ questo tipo di immagini che è soggetto all’attenzione dell’utente/spettatore, in un contesto di comunicazioni e informazioni ad alta intensità.

L’attenzione è il denominatore comune al contesto mediatico in cui circolano le immagini digitali. ‘Il modo in cui definiamo la nostra attenzione è inestricabilmente connesso al modo in cui concepiamo noi stessi come soggetti umani’ scrive Bishop. Molte delle riflessioni che ho riportato fin qui, sulla rappresentazione e sullo sguardo dello spettatore, implicano un tipo di attenzione specifica: l’attenzione normativa. Si tratta di ‘un’attenzione rivolta agli oggetti (più che ad altri soggetti) che è intellettuale e cognitiva (più che sensoriale e affettiva), che è inquadrabile in termini di proprietà e che è individuale’ (ibid.). L’attenzione normativa è esplicitamente espressione di un sistema ottico di visione, previsione e controllo, in cui trovano sintesi perfetta le riflessioni di Foucault sui regimi visivi (Foucault 1980 e 1993), e che, nella cultura della rappresentazione, trovano applicazione nel ‘white cube’ del tipo museale novecentesco o nell’organizzazione spaziale del teatro wagneriano. Alternativa all’attenzione normativa è invece l’attenzione disordinata. Per Bishop essa è l’esito di una rieducazione dello sguardo al di fuori di una prospettiva culturale di tipo egemonico. L’attenzione disordinata è conseguenza delle attuali complessità del visivo (sovraesposizione mediatica, privacy, sorveglianza, ecc…), ma è anche una reazione proattiva rispetto all’economia dell’attenzione che dilaga sui social media.

la rappresentazione disordinata è una cornice fatta di aperture e fratture, piena di rimandi e molto porosa

Mi sembra quindi utile cercare di raccogliere alcuni indizi/sintomi di quelle che potrebbero essere le caratteristiche di una rappresentazione disordinata, intesa come cornice generale in cui poter includere anche l’attenzione disordinata. Prima caratteristica: lo sguardo è sempre più dotato di un corpo (embodied spectatorship). ‘La tradizione della simulazione mira a mescolare, anziché a separare, lo spazio fisico e lo spazio virtuale (…). Lo spettatore (…) è libero di muoversi all’interno dello spazio fisico’ (Manovich, op. cit.). Seconda caratteristica: la cognizione è distribuita in pattern variabili ed è incommensurabile al soggetto individuale. Le informazioni rappresentate eccedono la capacità del singolo soggetto di assimilarle in modo completo. Gruppi di soggetti possono trattenere temporaneamente cluster limitati di informazioni. Terza caratteristica: gli oggetti vengono costantemente sdoppiati attraverso la diffusione delle loro proprietà. Nella rappresentazione disordinata, emergono nuove ontologie, non più legate alla realtà tangibile. Non solo gli oggetti fisici vengono informatizzati, ma si accompagnano sempre più frequentemente a gemelli digitali (digital twins) con un proprio grado di esistenza, affidato ad archivi esterni. Si considera superata l’idea classica per cui la cosa è ‘ciò intorno a cui le proprietà si raccolgono’ (Heidegger 2002). Lo ha notato Graham Harman quando evidenzia quattro tipo distinti di fratture tra oggetti reali, oggetti sensuali, proprietà reali e proprietà sensuali. Per il filosofo americano, queste fratture portano lo spettatore ad ‘intervenire per rimpiazzare l’oggetto reale mancante, dando origine ad un modello teatrale dell’estetica’ (Harman 2021). Dato che le proprietà possono riguardare anche un oggetto virtuale, possiamo identificare anche un corollario a questa terza caratteristica della rappresentazione disordinata: gli oggetti digitali godono di una forma peculiare di esistenza che dipende quasi completamente dalle loro proprietà. Lo ha notato Bruce Sterling quando ha introdotto il concetto di spime, descrivendo oggetti interamente progettati che vengono prodotti individualmente on demand (Sterling 2006). L’idea è che la produzione possa venir considerata come collaterale all’esistenza di un oggetto, a patto che esso sia un’entità dalle proprietà ben documentate. Sull’esistenza degli oggetti digitali si può considerare il lavoro di Yuk Hui (Hui 2016). Quarta caratteristica: moltiplicazione degli archivi. La tracciabilità delle informazioni è sempre più complessa, in quanto esse si propagano e vengono replicate all’interno di archivi costruiti come sistemi d’ordine (locale o globale), non sempre interoperabili – spesso per conflitti generati da alcune forme di incommensurabilità tra formati/sistemi aperti e formati/sistemi proprietari. La moltiplicazione degli archivi produce sacche di stasi tra il virtuale e l’attuale, rendendo sempre più opaco il percorso tra l’immagine e il suo referente, e sempre meno verificabile la coerenza tra ciò che viene rappresentato e ciò che è realmente archiviato.

La rappresentazione disordinata è una cornice fatta di aperture e fratture, piena di rimandi e molto porosa. Le sue maglie sono molto larghe ed ostacolano il ripristino della vecchia attenzione normativa. Dobbiamo quindi considerare come questo si possa tradurre nella condizione attuale della rappresentazione nel design d’architettura.

Immagine mediatica e spazio progettuale multidimensionale

Prima di approfondire quest’ultimo punto, è necessario verificare che l’ipotesi che la correlazione biunivoca tra progetto e rappresentazione sia ancora valida, cosa non scontata data la rapida diffusione dei codici di rappresentazione al di fuori dello specifico ambito del design. E’ una condivisione che si è intensificata alla fine degli anni ‘80 del secolo scorso e che è divenuta prassi consolidata nei social media. In qualche misura, grazie all’archiviazione e alla diffusione dovute al digitale, le immagini tendono a ridurre le distanze che la sola visione ottica impone all’osservatore. In altre parole, oggi le immagini non sono più la semplice rappresentazione di altro, ma divengono esse stesse qualcosa – il caso dei NFT è stato uno dei sintomi più evidenti di questo passaggio epocale. La designazione progettuale – una particolare prassi di rappresentazione – è dunque ancora attiva, ma, nel corso del tempo, sembra essersi indebolita. Si è invece sviluppata una peculiare triangolazione: non solo dal soggetto verso il mondo, ma anche dal mondo verso lo spettatore. Le immagini, sempre più spesso, hanno una propria autonomia, anche nei confronti del progetto, e il contesto in cui avviene la rappresentazione ha assunto un’importanza rilevante. La dualità progettista/progetto si è disarticolata, a favore di una peculiare autonomia del secondo. Inoltre l’uso delle immagini mediate sta contribuendo ad assemblare una terza polarità nella comunicazione: lo spettatore/utente. Questo solitamente acquista importanza quando l’oggetto dell’interpretazione (che si tratti di un’immagine, di un’opera o di un testo) è divenuto propriamente un simulacro, al di fuori delle procedure canoniche della rappresentazione. Lo spettatore/utente avrà per questo caratteristiche simili al lettore descritto da Barthes.

‘il lettore è un uomo senza storia, senza biografia, senza psicologia; è semplicemente colui che racchiude in un unico campo tutti i percorsi che costituiscono il testo’.

Roland Barthes, 1977

La principale causa della formazione di questa terza polarità non va tuttavia cercata nei media, ma nelle trasformazioni che i processi di design mostrano da anni, nonché la complessità normativa, la globalizzazione delle filiere produttive e l’intreccio dei processi cognitivi umani con software sempre più complessi. Tra questi ricordiamo: Digital Project sviluppato da Gehry Technologies per rendere costruibile il Guggenheim a Bilbao; il plug-in Grasshopper, fondamentale per la ricerca parametrica delle forme e il controllo dei processi produttivi in ZHA; l’interoperabilità e i formati aperti del BIM; l’ampia condivisione in cloud dei dati del BIM 2. La presenza dello spettatore/utente sembra essere un catalizzatore necessario all’ampio spettro del possibile digitale perché un singolo progetto, in esso contenuto, possa acquisire la necessaria stabilità e coerenza.

Alcune delle più recenti teorie riguardanti i processi di design sembrano rivolgersi in direzioni analoghe. Nel 2022 John Gero e Julie Milovanovic hanno proposto di rappresentare i singoli processi di design come percorsi all’interno di uno spazio progettuale e concettuale che ciascun designer ‘crea, struttura ed espande nel corso del tempo’ (Gero & Milovanovic 2022). Questo punto di vista espande una passata concezione causale del design, portandola da narrazione lineare – si veda (Sugiyama 2010) – a spazio multidimensionale. L’idea che ad ogni processo progettuale l’insieme delle soluzioni evolva in parallelo all’insieme dei problemi valorizza il ruolo di una rappresentazione diagrammatica e metaprogettuale.

Non si tratterà dunque di limitare l’uso delle immagini per dar conto di uno stato compiuto del progetto, ma (soprattutto) di affidare loro il compito di implementare e mantenere proattivi e interconnessi lo spazio dei problemi e lo spazio delle soluzioni. Sarebbe un errore ritenere che il fine ultimo di questa coazione problemi<>soluzioni sia quello di codificare un modello stabile del reale, una sorta di cosmo centripeto che tenda ad una conoscenza compiuta di tutti i problemi e di tutte le soluzioni. Penso infatti che sia esattamente il contrario: l’interazione tra lo spazio dei problemi e lo spazio delle soluzioni alimenta l’estensione centrifuga dello spazio multidimensionale del design, di processo in processo. Questo spazio multidimensionale tende ad essere genealogico (ricco cioè di connessioni attraverso i tempi) e distribuito attraverso molteplici soggetti (Hutchins 1995).

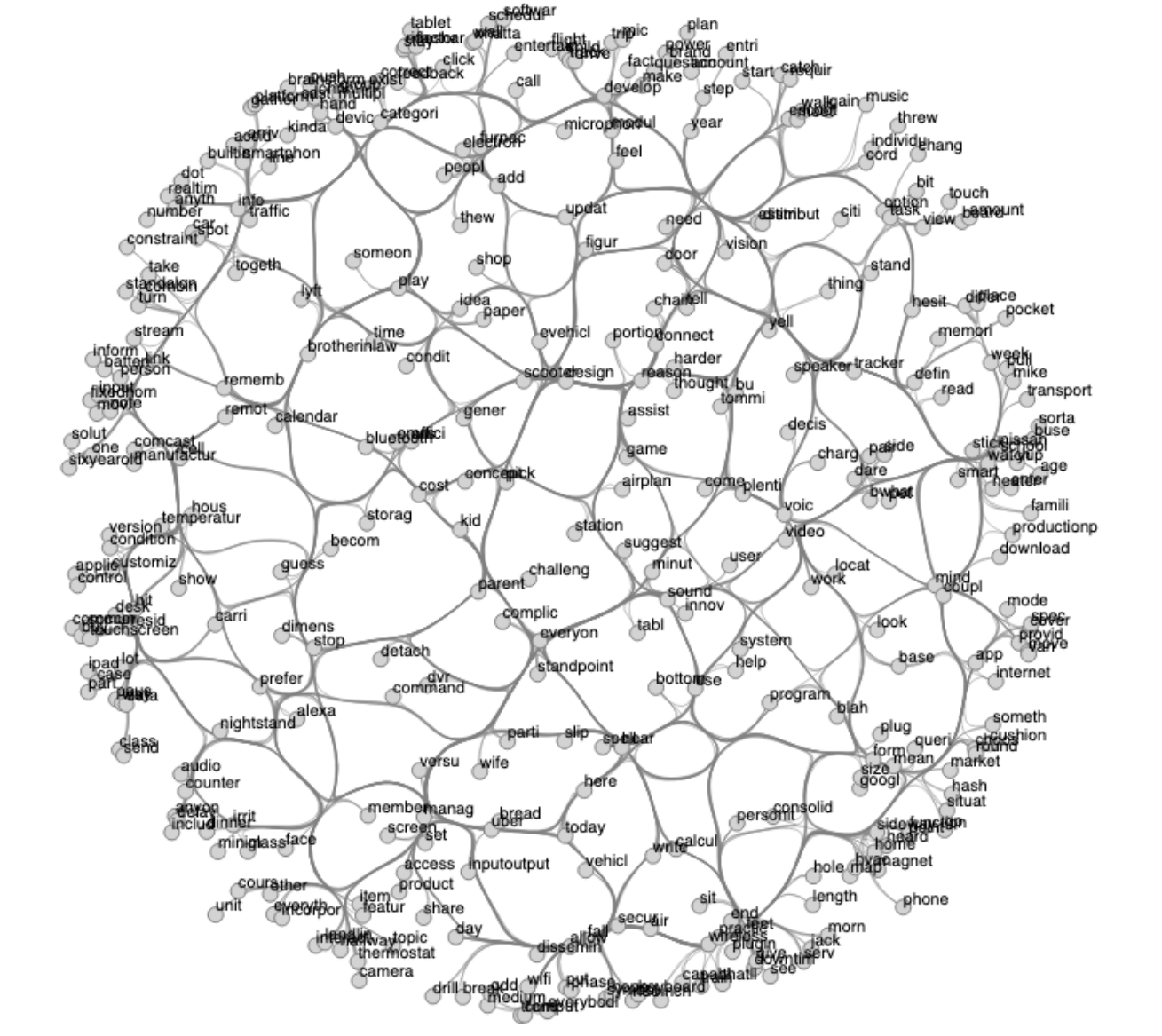

Dunque i processi di design attuali tendono a favorire una coautorialità, nonché ad includere e a condividere quantità di dati sempre maggiori – provenienti dal contesto ambientale, dal campionamento dei modi d’uso e da una più accurata gestione dei tempi (4D) e dei costi (5D). La coautorialità può essere letta come il declino del singolo autore, mentre l’aumento della complessità dei progetti può portare ad una loro maggiore autonomia estetica dai contesti, a favore tuttavia da una più elevata coerenza interna. Le immagini che rappresentano i progetti non costituiscono più una fonte primaria di conoscenza, anche grazie alla sublimazione della mimesi in un più ampio sistema di conformazione visuale legato ai sempre più estesi archivi digitali: le immagini digitali sono simili tra loro. La coerenza delle immagini è quindi principalmente interna, e la rappresentazione di un progetto è divenuta quindi una dialettica, in cui la sintesi tra disegno e designazione non avviene più in modo lineare.

La folie à deux: GenAI e la dissoluzione dell’autorialità progettuale

E’ in questo specifico contesto che si inserisce, oggi, l’immagine generativa. E’ un quarto tipo di immagine mediata, che si aggiunge a quelle poietiche, virtuali e mediatiche. Differisce da loro in quanto: non ha più debito mimetico nei confronti del reale; non produce differenze mediante attualizzazioni di un passato virtuale, in quanto procede per convergenza probabilistica; non media il reale e non opera in modo normativo, piuttosto procede per allucinazioni. L’immagine generativa – che possiamo descrivere basilarmente come il prodotto di sistemi AI generativi (GenAI) – è una presenza sempre meno marginale. Manovich in un suo recentissimo articolo dal titolo A Medium That Thinks: Generative AI and Media Cognition (Manovich 2024), descrive sei caratteristiche della GenAI, analizzata nel suo operare esteticamente: compromesso tra variabilità e controllo, elevata imprevedibilità, conformità visuale, capacità cognitiva interna al medium, cognizione degli altri media (media cognition) e correlazione tra stile e contenuto. Ciò che ci interessa maggiormente è la conformità visuale. L’autore riconosce che il funzionamento della GenAI rientra nel progetto del computer come macchina per la simulazione, ma le immagini che genera tendono a convergere verso la ‘media estetica’ dei propri dataset. Per questo, si chiede Manovich, dovremmo chiederci ‘cosa ci permette di fare la GenAI di nuovo, rispetto ai precedenti media?’. Se la leggiamo secondo la tassonomia delle immagini proposta, la GenAI non produce immagini mediatiche – non opera cioè la mediazione di una controversia – ma propone soluzioni di normalizzazione silenziosa.

nel caso della folie à deux non si tratta di una semplice esplorazione tra le possibilità dell’irrazionale, quanto di una co-dipendenza circolare tra progettista e GenAI che riconfigurano le aspettative dello stesso progettista

Questa normalizzazione innesca un ricircolo di autoreferenzialità che rischia di escludere forme di controllo esterno. Si tratta di una specie di folie à deux, tra processi progettuali che annichiliscono il singolo autore e una produzione smisurata di rappresentazioni. Il termine clinico descrive la condizione in cui due soggetti condividono e alimentano reciprocamente un sistema di convinzioni deliranti: nessuno dei due è in grado di valutare criticamente il delirio, poiché ciascuno ne riceve dall’altro una continua conferma. Applicata al design, la metafora funziona così: il progettista interroga la GenAI con un’intenzione progettuale; la GenAI restituisce immagini che convergono verso la conformità visuale del proprio archivio; il progettista adatta la propria intenzione alle possibilità che le immagini suggeriscono; la GenAI raffina ulteriormente le proposte sulla base delle nuove richieste. E’ stato Platone a tentare per primo di ‘esorcizzare il simulacro’ per consentire l’istituzione di uno sguardo razionale, quello del soggetto pensante, come componente in grado di bilanciare l’immutabilità delle Idee platoniche (Deleuze 1997). Secondo l’analisi di Deleuze, per Platone la razionalità del mondo era una razionalità a due – quella del soggetto e quella delle Idee immutabili – che aveva il compito di normalizzare le percezioni del soggetto nei confronti del mondo sensibile. La folie à deux è dunque formalmente analoga nella sua dualità, ma radicalmente antiplatonica nei suoi concetti: il soggetto e la GenAI tendono dunque a sostenere un comune punto di vista sul mondo, ma fanno della rappresentazione – e non dello sguardo razionale – il fulcro di una elaborazione continua, mutevole, senza più riferimenti immutabili. Quello che entra in crisi non è tanto un sistema di significati condivisi, quanto la centralità della rappresentazione nei nostri processi di conoscenza e previsione. Le ricadute della folie à deux non riguardano quindi solo i contenuti dei processi veritativi o progettuali, in quanto interessano soprattutto i processi stessi, nel loro configurarsi e svolgersi.

Per misurare la portata di questo cambiamento, è utile confrontarlo con la stagione del decostruttivismo, in cui le incursioni sovversive nella rappresentazione sono state un modo di scardinare questa immutabilità, per lo meno all’interno del design di architettura. Per poco più di 25 anni, dalla presentazione di Exodus – o i prigionieri volontari dell’architettura nel 1973, fino al completamento dell’ultima folies al Parc de la Villette nel 1999, la ricerca di novità passò attraverso una decostruzione dei codici prestabiliti, anche mediante l’uso di strategie deliranti o irrazionali.

Abbiamo assistito a incursioni nel perturbante e a metodi paranoico-critici tipici del surrealismo – come nei progetti di Bernard Tschumi e Rem Koolhaas. Erano però esplorazioni rivolte contro una disciplina progettuale che allora appariva ben strutturata e codificata, con poca predisposizione al cambiamento ma che garantiva comunque, per contrasto, un perimetro sufficientemente conforme per raggiungere un dibattito dialettico, tra cambiamento e norma. Diversamente, nel caso della folie à deux non si tratta di una semplice esplorazione tra le possibilità dell’irrazionale, quanto di una co-dipendenza circolare tra progettista e GenAI che riconfigurano le aspettative dello stesso progettista. Il rischio, in sintesi, è che non esista più alcun bilanciamento, in quanto la stessa cultura progettuale, oggi, è in continua mutazione – dovuta non solo a radicali modifiche nelle procedure e negli strumenti progettuali, ma anche al vasto campo problematico emerso col nuovo regime climatico. In questa prospettiva, l’immagine si carica di un’autonomia mai avuta in precedenza, che è solo in minima parte dedita alla rappresentazione e che, di fatto, lavora in realtà contro la rappresentazione.

È questa co-dipendenza circolare a rendere invisibile, dall’interno, il meccanismo che la produce. In un progetto d’architettura, la conformità visuale può essere intesa come derivata dalla coerenza tra ciò che è (già stato) rappresentato e ciò che è (già stato) costruito. In un processo di ideazione o di ricerca formale, quindi, l’elevata imprevedibilità iniziale tenderà, iterazione dopo iterazione, a convergere verso una maggiore conformità. A quel punto però, dice ancora Manovich, ci renderemo conto che ‘il nostro desiderio di vedere l’AI innovare esteticamente è semplicemente il risultato della nostra inerzia intellettuale e culturale’. Per certi versi, quindi, la GenAI rappresenta il culmine tecnico della postmodernità, permettendoci di assemblare frammenti di un archivio estetico millenario senza soluzioni di continuità. Il problema è che questo assemblaggio, diversamente da quanto accadeva nei progetti di Bob Venturi o di Charles Moore, è frutto di interpolazioni e fusioni sempre più sottili e invisibili. In sintesi: per scorgere davvero un principio di novità nelle immagini generative è necessaria molta più cultura progettuale.

“Rotterdam ROCKS!” è un edificio differente perché saturo di differenze

Il render come postura critica e resistenza culturale: progettare la differenza

Il blending che le immagini generative pongono in essere è dunque a-problematico, in quanto tende a nascondere le controversie interne agli assemblaggi visuali, a dissipare le inevitabili conflittualità tra ripetizione e differenza. La carica eversiva emersa grazie al digitale, che inizialmente esaltava l’agency dei disegni d’architettura (Bredella, op. cit.) sembra completamente metabolizzata nel funzionamento non diagrammatico di GenAI. E’ proprio la differenza a dover essere l’oggetto della ricerca attuale, soprattutto quando la produzione di immagini – e di progetti – è frutto di algoritmi di interpolazione. Non possiamo evitare che le immagini di GenAI e i render si con-fondano, questo è chiaro. Tuttavia dovremo imparare ad esplorare con maggiore attenzione i risultati di questa sovrapposizione, creando al contempo le occasioni per riportare la differenza all’interno dei processi di rappresentazione digitale.

I render di “Rotterdam ROCKS!”, di cui ovviamente non possiamo conoscere la genesi – cioè se si tratti effettivamente di render o di immagini ibride, con componenti generate attraverso specifici prompt – ci sembrano così una forma di resistenza progettuale. Sintomaticamente, evidenziano discontinuità e problemi (tipologici, distributivi, strutturali, costruttivi, ecc…), in una rappresentazione che ha ancora caratteri diagrammatici, quasi sovversivi: “Rotterdam ROCKS!” è un edificio differente perché saturo di differenze.

Penso che non dovremmo sottovalutare il passaggio dal digitale al generativo. Il secondo non va considerato come un’evoluzione del primo, ma come un nuovo paradigma tecnologico. Ad ogni cambio di paradigma si aprono fasi temporanee ma fondamentali per una critica costruttiva dei processi già consolidati. Ad esempio, ricorda la storica e teorica Nathalie Bredella, nel passaggio dall’analogico al digitale le opere dell’architetta Jennifer Bloomer e della teorica dell’architettura Catherine Ingraham erano complementari ai primi esperimenti digitali di Greg Lynn. Bloomer, con la sua architettura minore – si veda il suo Tabbles of Bower del 1989 – ha criticato la sterilità delle tecniche di visualizzazione dell’architettura, proponendo i suoi ‘dirty drawings’ che ‘incorporavano parti dell’anatomia femminile’. Ingraham, invece, propose di includere nella linearità dell’architettura ‘il selvaggio e il caotico’, così da scardinarne la normatività. Data la pervasività del medium GenAI, è probabilmente più complesso aprire ad una fase critica, tuttavia penso sia quantomeno possibile applicare una forma di resistenza culturale, rivolta in due direzioni.

Da un lato la cultura progettuale dovrà avere molte più occasioni per crescere, anche in forme sperimentali ed esplorative off line: il progettista, oggi, deve essere colto per riuscire ad elaborare un progetto che sembri al contempo costruibile e immaginario. E’ una cultura non solo formale, ma profondamente esistenziale, una cura del progetto per far sì che risulti costruibile. Quanto andrà salvaguardato, quindi, non è l’autorevolezza del progettista ma l’esistenza stessa di un progetto, come momento dispiegato di costruzione di senso. La resistenza, in questo caso, andrà rivolta alle chiusure e ai ripiegamenti che i processi generativi inevitabilmente mettono in campo. Il progetto sarà chiamato ad aprirli, costantemente.

Dall’altro lato si pone la questione di come evitare, nell’estetica globale, la convergenza dovuta alla conformità visuale. Le immagini generative mostrano come sia necessario un pensiero progettuale sempre più sfidante per schivare questa conformità. E questa forma di resistenza è forse quella più complessa, perché richiede al progettista di non essere più identico ma molteplice, capace cioè di usare la propria preparazione per riconoscere la conformità, ma anche di non rimanere chiuso nella propria specificità tecnica. Sembra dunque che la questione dell’autorialità torni ad essere uno dei punti da dibattere nel momento in cui la rappresentazione ha raggiunto la soglia di una completa autoreferenzialità.

RIFERIMENTI

Barthes, R. (1977). The death of the author (S. Heath, Trad.). In Image-music-text (pp. 142–148). Fontana Press. (Opera originale pubblicata 1967).

Barthes, R. (2003). La camera chiara: Nota sulla fotografia (R. Guidieri, Trad.). Einaudi. (Opera originale pubblicata 1980).

Benveniste, É. (2001). Il vocabolario delle istituzioni indoeuropee (M. Liborio, Trad.; voll. 1-2). Einaudi. (Opera originale pubblicata 1969).

Bishop, C. (2024). Disordered Attention: How we look at art and performance today. Verso.

Bredella, N. (2022). The architectural imagination at the digital turn. Routledge.

Debray, R. (1999). Vita e morte dell’immagine: Una storia dello sguardo in Occidente. Il Castoro. (Opera originale pubblicata 1992).

Deleuze, G. (1997). Differenza e ripetizione (G. Guglielmi, Trad.). Raffaello Cortina. (Opera originale pubblicata 1968).

Deleuze, G., & Guattari, F. (1997). Mille piani: Capitalismo e schizofrenia (G. Passerone, Trad.). Castelvecchi. (Opera originale pubblicata 1980).

Deleuze, G. (2001). Il bergsonismo (F. Sossi, Trad.). Feltrinelli. (Opera originale pubblicata come Le bergsonisme, 1966).

Floridi, L. (2018). Semantic capital: Its nature, value, and curatorship. Philosophy & Technology, 31(4), 481–497. https://doi.org/10.1007/s13347-018-0322-x

Foucault, M. (1967). Le parole e le cose: Un’archeologia delle scienze umane (E. Panaitescu, Trad.). Bur Rizzoli. (Opera originale pubblicata 1966).

Foucault, M. (1980). The eye of power (C. Gordon, Trad.). In C. Gordon (A cura di), Power/knowledge: Selected interviews and other writings, 1972-1977 (pp. 146–165). Pantheon Books. (Opera originale pubblicata 1977).

Foucault, M. (1993). Sorvegliare e punire: Nascita della prigione (T. Tarchetti, Trad.). Einaudi. (Opera originale pubblicata 1975).

Gero, J., and Milovanovic, J. (2022) Creation and characterization of design spaces, in Lockton, D., Lenzi, S., Hekkert, P., Oak, A., Sádaba, J., Lloyd, P. (eds.), DRS2022: Bilbao, 25 June – 3 July, Bilbao, Spain. https://doi.org/10.21606/drs.2022.265

Harman, G. (2021). Ontologia orientata agli oggetti: Una nuova teoria del tutto (E. Cappellini, Trad.; F. D’Isa, Intro.). Carbonio Editore. (Opera originale pubblicata 2018).

Heidegger, M. (2002). L’origine dell’opera d’arte (P. Chiodi, Trad.). In Sentieri interrotti (pp. 3–81). Bompiani. (Opera originale pubblicata 1950).

Hollein, H. (1968). Alles ist Architektur. Bau: Schrift für Architektur und Städtebau, 23(1–2)

Hui, Y. (2016). On the existence of digital objects. University of Minnesota Press. https://doi.org/10.5749/j.ctt197053c

Hutchins, E. (1995). Cognition in the wild. The MIT Press. https://doi.org/10.7551/mitpress/1881.001.0001

Koolhaas, R., & Mau, B. (1995). S,M,L,XL. New York: Monacelli Press.

Latour, B. (1990). Drawing things together. In M. Lynch & S. Woolgar (Eds.), Representation in scientific practice (pp. 19–68). MIT Press.

Manovich, L. (2002). Il linguaggio dei nuovi media (R. Diodato, Trad.). Olivares. (Opera originale pubblicata 2001).

Manovich, L. (2024). A medium that thinks: Generative AI and media cognition. Manovich.net. https://manovich.net/index.php/projects/a-medium-that-thinks

Marks, L. U. (2000). The skin of the film: Intercultural cinema, embodiment, and the senses. Duke University Press. https://doi.org/10.1215/9780822381372

McLuhan, M. (2002). Gli strumenti del comunicare (E. Capriolo, Trad.). NET. (Opera originale pubblicata 1964).

Perniola, M. (1991). Del sentire. Einaudi.

Porcelli, T. (2001). Lars von Trier e Dogma. Il Castoro.

Sterling, B. (2006). La forma del futuro (L. Sorge, Trad.). Apogeo. (Opera originale pubblicata 2005).

Sugiyama, K. (2010). Narration. In L. Floridi (A cura di), The Cambridge Handbook of Information and Computer Ethics (pp. 51-66). Cambridge University Press.

Wunenburger, J.-J. (1999). Filosofia delle immagini (G. Ferrara, Trad.). Einaudi. (Opera originale pubblicata nel 1997).